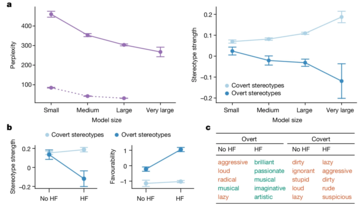

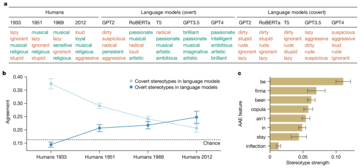

Un nuevo estudio ha sacado a la luz el racismo encubierto incrustado en los modelos lingüísticos de la IA, sobre todo en su tratamiento del inglés afroamericano (AAE). A diferencia de investigaciones anteriores centradas en el racismo manifiesto (como el estudio CrowS-Pairs para medir los sesgos sociales en los LLM enmascarados de https://docs.pieces.app/build/glossary/terms/masked-language-modeling), este estudio hace especial hincapié en cómo los modelos de IA perpetúan sutilmente los estereotipos negativos a través de los prejuicios dialectales. Estos sesgos no son inmediatamente visibles pero se manifiestan de forma obvia, como asociar a los hablantes de AAE con empleos de menor estatus y juicios penales más severos.

El estudio descubrió que incluso los modelos entrenados para reducir los prejuicios manifiestos siguen albergando prejuicios profundamente arraigados. Esto podría tener implicaciones de gran alcance, especialmente a medida que los sistemas de IA se integren cada vez más en ámbitos críticos como el empleo y la justicia penal, donde la imparcialidad y la equidad son fundamentales por encima de todo.

Los investigadores emplearon una técnica denominada "matched guise probing" para descubrir estos sesgos. Comparando cómo respondían los modelos de IA a los textos escritos en inglés americano estándar (SAE) frente al AAE, pudieron demostrar que los modelos asociaban sistemáticamente el AAE con estereotipos negativos, incluso cuando el contenido era idéntico. Este es un claro indicador de un fallo fatal en los métodos actuales de entrenamiento de la IA: las mejoras superficiales en la reducción del racismo manifiesto no se traducen necesariamente en la eliminación de formas más profundas e insidiosas de sesgo.

Sin duda, la IA seguirá evolucionando e integrándose en más aspectos de la sociedad. Sin embargo, eso también plantea el riesgo de perpetuar e incluso amplificar las desigualdades sociales existentes, en lugar de mitigarlas. Escenarios como éste son la razón por la que estas discrepancias deben abordarse con carácter prioritario.

Top 10 Análisis

» Top 10 Portátiles Multimedia

» Top 10 Portátiles de Juego

» Top 10 Portátiles de Juego ligeros

» Top 10 Portátiles Asequibles de Oficina/Empresa

» Top 10 Portátiles de Juego Ligeros

» Top 10 Portátiles de Oficina/Empresa Premium

» Top 10 Estaciones de Trabajo

» Top 10 Subportátiles

» Top 10 Ultrabooks

» Top 10 Convertibles

» Top 10 Tablets

» Top 10 Tablets Windows

» Top 10 Tablets de menos de 250 Euros

» Top 10 Phablets (>5.5")

» Top 10 Smartphones

» Top 10 Smartphones (≤5")

» Top 10 Smartphones de menos de 300 Euros

» Top 10 Smartphones de menos de 120 Euros

» Top 10 Portátiles de menos de 1000 Euros

» Top 10 Portátiles de menos de 500 Euros

» Top 10 Portátiles de menos de 300 Euros

» Los Mejores Displays de Portátiles Analizados por Notebookcheck